在统计建模中,模型选择是一个重要的环节。选择合适的模型可以提高预测准确性和解释能力。AIC(赤池信息准则)是一种常用的模型选择方法之一。本文将介绍AIC模型的基本原理、计算公式以及与其他模型选择方法的比较。

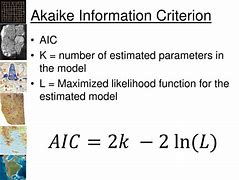

1. AIC模型的基本原理

AIC模型选择方法是由日本统计学家赤池弘次提出的。其核心思想是在模型的拟合优良性和复杂度之间进行权衡。AIC通过考虑模型的参数数量和对数似然值来评估模型的优劣。较小的AIC值表示模型更好。

2. AIC模型的计算公式

AIC的计算公式为:

AIC = -2ln(L) + 2k

其中,ln(L)是模型的对数似然值,k是模型的参数数量。AIC值越小,表示模型的拟合优良性和复杂度更好。

3. AIC模型与其他模型选择方法的比较

AIC模型选择方法与其他常用的模型选择方法(如BIC和交叉验证)相比,具有以下特点:

3.1 AIC vs. BIC

AIC和BIC(贝叶斯信息准则)都是常用的模型选择方法,但其原理和权衡因素略有不同。

- AIC:AIC主要关注模型的拟合优良性和参数数量。它通过惩罚参数数量来避免过拟合,更倾向于选择拟合优良且参数较少的模型。

- BIC:BIC在考虑模型的拟合优良性和复杂度时,引入了样本数量的惩罚项。相比AIC,BIC对参数数量更加严格,更倾向于选择拟合优良且参数更少的模型。

3.2 AIC vs. 交叉验证

交叉验证是一种通过将数据集划分为训练集和验证集,评估模型性能的方法。与AIC不同,交叉验证直接通过模型在验证集上的表现来评估模型的优劣。

- AIC:AIC通过对数似然值和参数数量的权衡来评估模型的优劣。它可以在模型选择时考虑多个模型,并选择AIC值最小的模型。

- 交叉验证:交叉验证通过模型在验证集上的性能评估来选择模型。它可以更直接地评估模型的预测准确性,但计算量较大。

4. 总结

AIC模型选择方法是一种常用的模型选择方法,通过对数似然值和参数数量的权衡来评估模型的优劣。与BIC和交叉验证相比,AIC更注重模型的拟合优良性和参数数量。在实际应用中,可以根据具体问题和数据集的特点选择合适的模型选择方法。

参考文献: